AI-дайджест недели: великий раскол, M&A-мания и война за чипы

OpenAI за $852B, NVIDIA покупает Groq, Китай атакует с чипами и open-source. Неделя, когда AI-индустрия раскололась на блоки. Анализ трендов.

Неделя 5–12 апреля 2026 года войдет в историю AI-индустрии как момент окончательной фрагментации. OpenAI достиг оценки в $852 млрд, выпустив super app. NVIDIA поглотила Groq за $20 млрд. Китай представил чип, бросающий вызов американской гегемонии. Белый дом опубликовал национальную AI-стратегию.

Что объединяет эти новости? Эпоха «AI для всех» закончилась. Началась эра блоков, где геополитика определяет технологии, M&A консолидирует рынок, а пользователей делят как нефтяные месторождения.

Если вы думали, что AI останется открытым и глобальным – добро пожаловать в реальность. Вот что произошло за неделю и почему это меняет все.

Геополитический раскол: AI больше не глобален

Белый дом опубликовал National AI Policy Framework – первую комплексную стратегию США по искусственному интеллекту. Документ фокусируется на безопасности, этике и конкурентоспособности. Но главное между строк: США готовится к долгой AI-войне с Китаем.

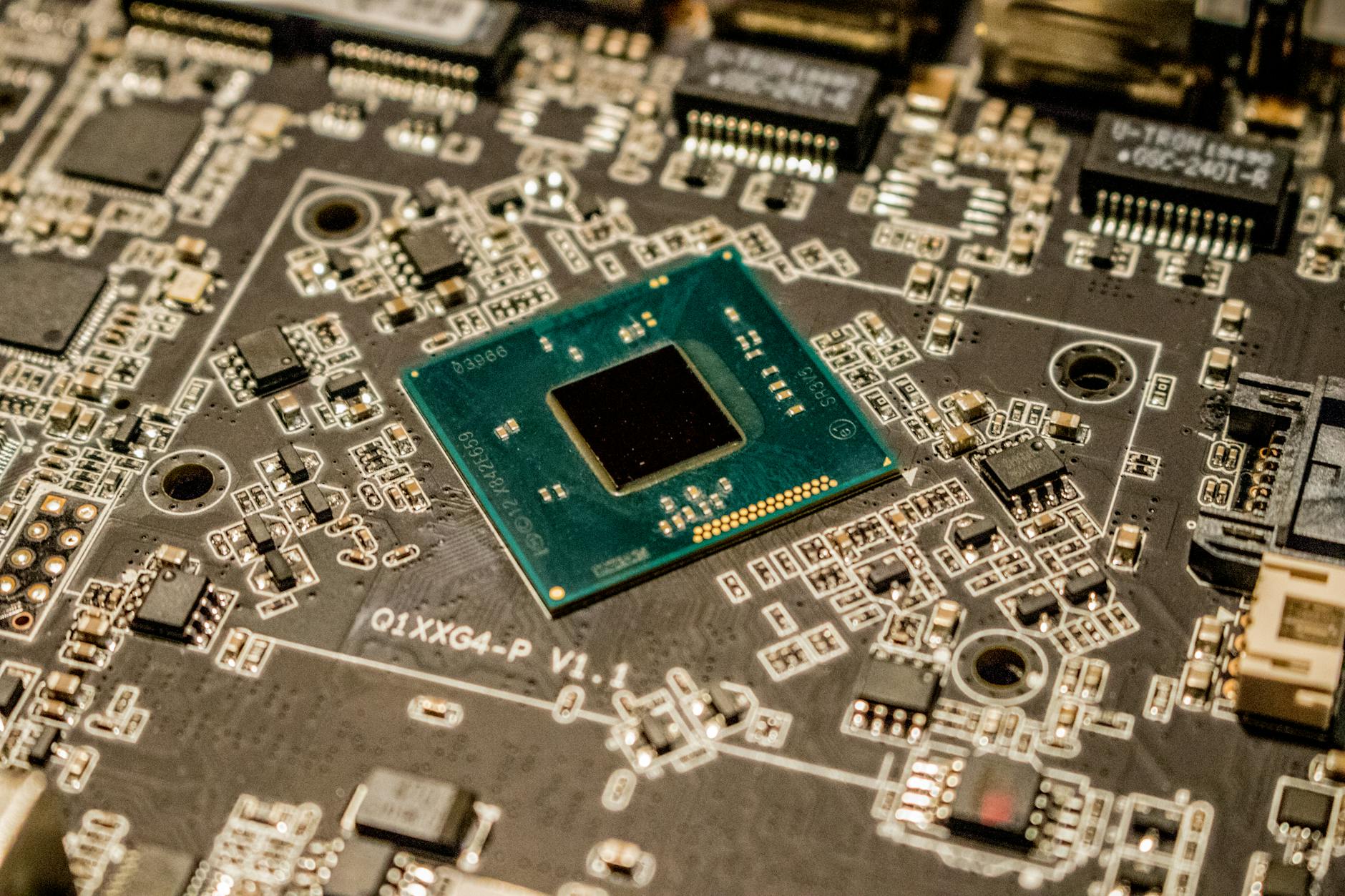

И Китай не заставил себя ждать. На той же неделе КНР представила AI-чип, который претендует на конкуренцию с NVIDIA. Название пока не раскрывается, но сообщается о производительности, сопоставимой с H100. Это прямой ответ на американские экспортные ограничения, которые душили китайскую AI-индустрию два года.

Третий удар: Alibaba выпустила Qwen3.6-Plus – open-source модель, которая возглавила глобальные чарты использования в первый же день. Это не просто хорошая модель. Это демонстрация силы: Китай может создавать мировые AI-стандарты без западной инфраструктуры.

Что это значит: Мир AI делится на два несовместимых стека. Западный (NVIDIA + OpenAI + Gemini) и китайский (собственные чипы + open-source модели). Для разработчиков это означает выбор экосистемы. Для корпораций – геополитические риски. Для пользователей – фрагментированный опыт.

Мы уже видели это с интернетом. Теперь AI повторяет сценарий. И это только начало.

M&A-мания: NVIDIA покупает будущее

NVIDIA купила Groq за $20 млрд. Это крупнейшая AI-сделка года и сигнал: эра маленьких независимых игроков в AI-инфраструктуре закончилась.

Groq специализировалась на сверхбыстром AI-инференсе. Их LPU (Language Processing Unit) обещали скорость в разы выше GPU. Теперь эта технология принадлежит NVIDIA – компании, которая уже контролирует 90%+ рынка обучения нейросетей.

Зачем NVIDIA это нужно? Inference – следующее поле боя. Обучение моделей – это разовые траты. Inference – это каждый запрос, каждый пользователь, каждую секунду. Масштабируется линейно. И здесь NVIDIA еще не доминирует полностью. Google, Amazon, Microsoft разрабатывают собственные чипы для inference. Meta строит свое hardware-подразделение (об этом ниже).

Покупка Groq – это NVIDIA страхует лидерство на следующие 5 лет.

Что это значит: Консолидация набирает обороты. Маленькие AI-стартапы в инфраструктуре будут либо куплены, либо задавлены. Вертикальная интеграция – новый тренд. Ожидайте еще десяток мега-сделок в 2026.

Война за пользователя: super apps, chatbots и корпоративный AI

OpenAI выпустила super app при оценке $852 млрд. Это больше не просто ChatGPT. Это платформа, объединяющая чат, поиск, productivity tools, API-интеграции. Похоже на WeChat, только для AI.

В тот же момент Google Gemini обогнал Perplexity и стал вторым по популярности chatbot после ChatGPT. Perplexity – независимый стартап, который казался непробиваемым в нише AI-поиска. Но Google задействовал интеграцию с Search, Android, Chrome. Результат предсказуем.

Microsoft не отстает. Copilot получил multi-model архитектуру: теперь он использует несколько LLM одновременно для точности и гибкости. Это превращает Copilot из «GPT в Office» в полноценную AI-платформу для enterprise.

Что это значит: Битва за пользователей переходит в фазу экосистемных войн. Независимые chatbots проигрывают гигантам с дистрибуцией. OpenAI, Google, Microsoft строят walled gardens. Пользователи выбирают не лучшую модель, а лучшую интеграцию.

Для стартапов это плохие новости. Для корпораций – тоже, потому что vendor lock-in усиливается. Для пользователей – удобнее, но менее свободно.

Гонка кастомных чипов: все хотят быть NVIDIA

Meta объявила о создании AI Hardware Division – отдельного подразделения для разработки собственных чипов. Это не первая попытка Meta в hardware, но первая настолько амбициозная.

Зачем? Meta тратит миллиарды на AI-инфраструктуру для соцсетей и метавселенной. Покупка чипов у NVIDIA – это зависимость и огромные расходы. Собственный silicon – это контроль и экономия.

Meta не одинока. Google делает TPU. Amazon – Trainium и Inferentia. Microsoft инвестирует в Maia. Теперь Meta. Все хотят быть NVIDIA, потому что никто не хочет зависеть от NVIDIA.

Ирония: NVIDIA на той же неделе анонсировала технологию, снижающую использование VRAM на 85%. Это радикально упрощает запуск больших моделей на consumer-GPU. Меньше барьеров, больше lock-in в экосистему CUDA.

Что это значит: AI-инфраструктура становится вертикально интегрированной. Гиганты строят собственные стеки от чипа до модели. Это ускоряет инновации, но фрагментирует индустрию. Разработчикам придется выбирать не только модель, но и hardware-платформу.

Модельная гонка: скорость, эффективность, мультимодальность

Google выпустила Gemini 3.1 Flash Live – флагманскую модель с акцентом на скорость и real-time приложения. Обещают превосходство в бенчмарках и интеграцию во всю экосистему Google.

Это часть большого тренда: модели становятся быстрее, эффективнее, мультимодальнее. GPT-4 был медленным. GPT-4 Turbo – быстрее. Теперь все гонятся за latency и cost-efficiency.

Почему? Потому что inference-экономика требует скорости. Пользователи не ждут 10 секунд ответа. Корпорации не платят $1 за запрос. Edge-приложения требуют real-time.

Gemini 3.1 Flash Live – это Google ставит на скорость как конкурентное преимущество. Посмотрим, как ответят OpenAI и Anthropic.

Что это значит: Модельная гонка смещается от «лучших результатов» к «достаточно хорошим за миллисекунды». Это открывает новые use cases (real-time ассистенты, edge AI), но и коммодитизирует базовые возможности. LLM становятся утилитой, как электричество.

Тренды недели: что объединяет эти новости

Три мета-тренда:

1. Фрагментация. AI раскалывается на геополитические блоки (США vs Китай), экосистемы (OpenAI vs Google vs Microsoft), hardware-платформы (NVIDIA vs custom chips). Глобальный открытый AI – это прошлое.

2. Консолидация. M&A ускоряется (NVIDIA–Groq), гиганты давят стартапы (Gemini vs Perplexity), вертикальная интеграция растет (Meta делает чипы). Маленькие игроки выживают только в нишах или через acquisition.

3. Экосистемные войны. Пользователей делят не моделями, а интеграцией. Super apps (OpenAI), multi-model платформы (Microsoft), поисковое доминирование (Google). Это битва за walled gardens, не за лучший AI.

Заключение: и что дальше?

Неделя показала: AI перестал быть технологией и стал геополитикой, экономикой, инфраструктурой. Это больше не стартап-история. Это история империй.

США строит AI-fortress через регулирование и M&A. Китай отвечает чипами и open-source. Корпорации запирают пользователей в экосистемы. NVIDIA скупает будущее.

Открытый вопрос: а где здесь место для независимых разработчиков, исследователей, стартапов? Или AI окончательно становится игрой для трех-четырех игроков, а остальные – просто пользователи их платформ?

Возможно, мы пропустили что-то важное на этой неделе. Пишите, если заметили.

Хотите такую же автоматизацию?

Настроим AI-фабрику контента для вашего бизнеса за 3 дня.

Обсудить проект